用信息瓶颈学习胶囊网络解纠缠表示

点击数: 782 更新日期: 2022-09-30

中文标题:用信息瓶颈学习胶囊网络解纠缠表示

论文标题β-CapsNet: Learning Disentangled Representation for CapsNet by Information Bottleneck

论文录用时间:2022年8月12日

录用期刊:Neural Computing and Applications(Q1)

原文DOI : 10.1007/s00521-022-07729-w

作者列表:

1) 胡铭菲 (中国石油大学(北京) 信息科学与工程学院 2018级博士)

2) 刘建伟 (中国石油大学(北京) 信息科学与工程学院 自动化系)

胶囊网络是一个很有前景的概念,在部分数据集上获得了不错的分类、聚类和重构效果,但胶囊网络学习到的隐表示总是纠缠的。当前对胶囊网络的研究主要集中于动态路由算法的改进、计算复杂度的压缩、胶囊结构以及应用扩展,解纠缠的研究还是一个空白的领域。作为一个具有可解释属性的模型,探索胶囊网络的解纠缠模型,进一步提高可解释性对模型的性能提升和应用扩展是十分重要的。本章提出了一种基于信息瓶颈理论的学习胶囊网络解纠缠表示的方法,该方法在监督学习和无监督学习下均有效。信息瓶颈约束和解纠缠表示有很强的内在联系,但其使用的度量方法是难以求解的互信息,通过信息论的角度引入变分推断,获得信息瓶颈约束项的变分界,此时胶囊网络的目标函数与β-VAE的表达形式类似,因此称该方法为β-CapsNet。计算变分界时需要给出胶囊表示的先验分布和编码过程的后验分布,假设表示中的每个胶囊向量内神经元服从正态分布,则信息瓶颈约束项的变分界等价于对胶囊向量的均值和方差的两个约束条件。实验发现,胶囊的方差与胶囊向量中神经元的个数、模型结构和输入数据的类型有关,而胶囊的均值影响了表示胶囊的解纠缠性能,因此只需用系数β调节胶囊均值以获得不同的解纠缠性能。

给定输入样本x、表示z和目标y,信息瓶颈理论认为约束输入x和表示z之间的互信息能够增强表示的可解释性。从信息论的角度看,这是因为表示空间受到了合理的压缩,类似于生成模型中解纠缠约束的原理。在胶囊网络中,添加信息瓶颈约束项后的目标函数为:

![]()

从信息量的角度给出一个更简单的推导过程,利用变分推断技巧可得互信息![]()

的变分上界:

![]()

实验发现,单独约束胶囊的均值就可以获得好的解纠缠效果,且对其他任务的影响较小,因此可以将信息瓶颈约束项进一步简化为:

![]()

在监督学习中,胶囊网络的表示由代表不同类别的分类胶囊组成,我们提出类别独立掩码向量替代原有的掩码矩阵,在掩码过程中只允许正确类别的分类胶囊通过而舍去其他类别的胶囊,新的掩码能够帮助胶囊网络综合地理解类别之外的变化因素,使模型具有更好的可解释性。在无监督学习中,数据没有标签信息,表示只需要包含一个胶囊即可,因此本文设计了新的无监督动态路由算法以及相应的模型结构。

实验:

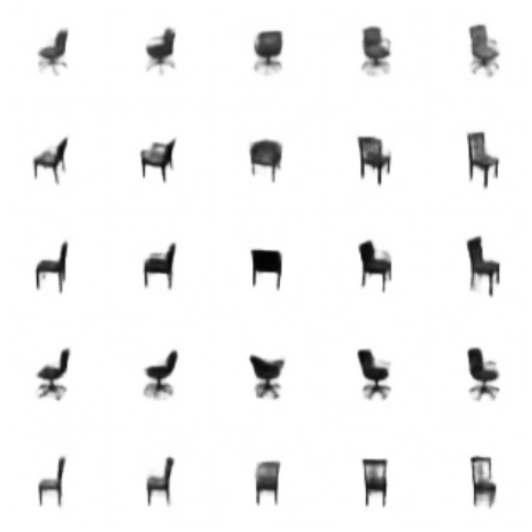

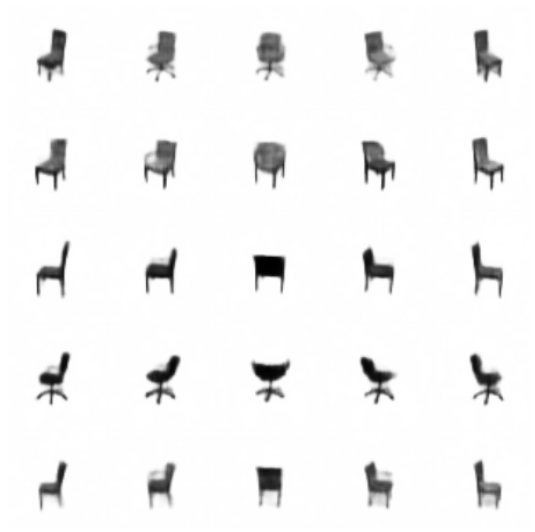

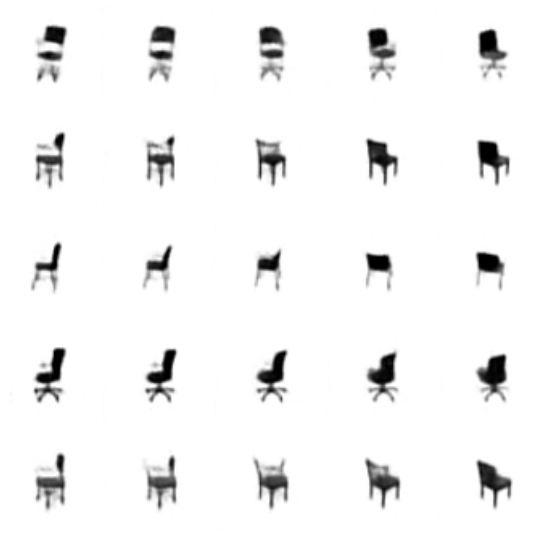

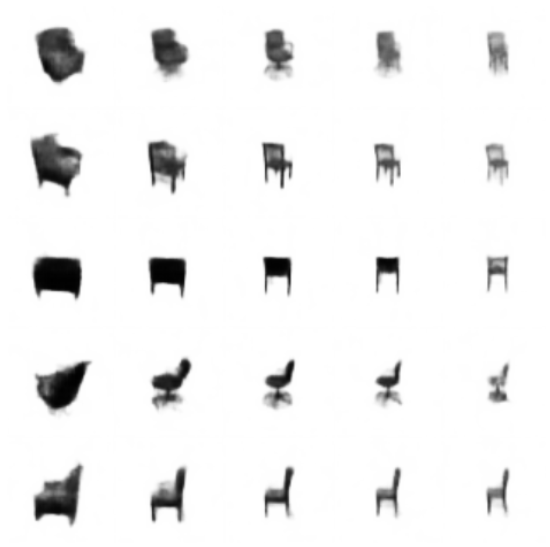

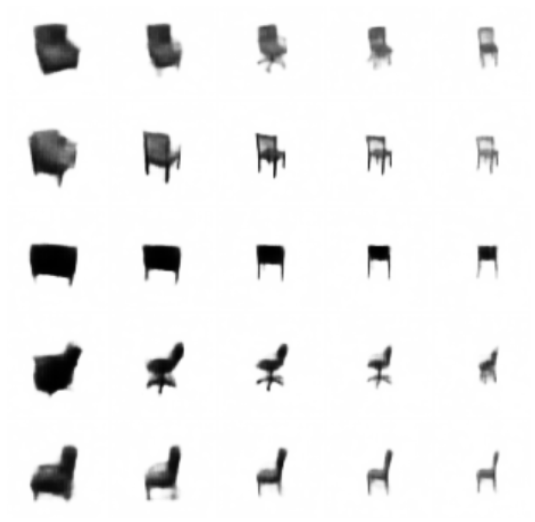

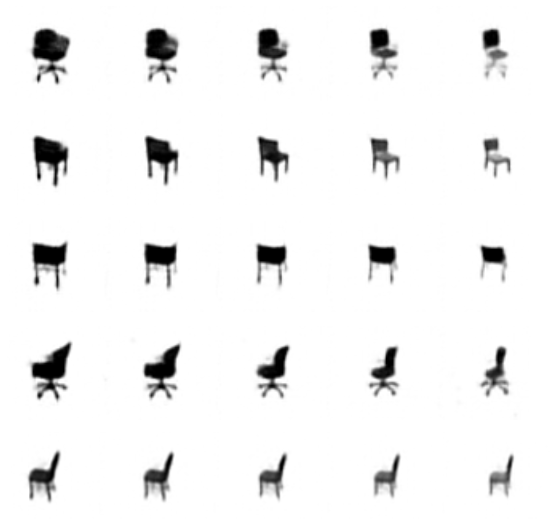

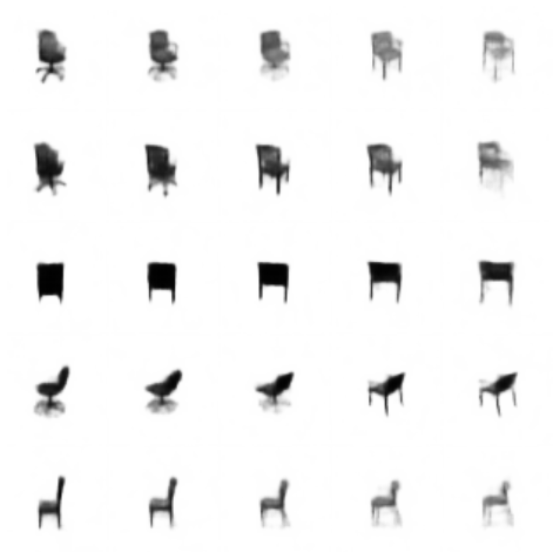

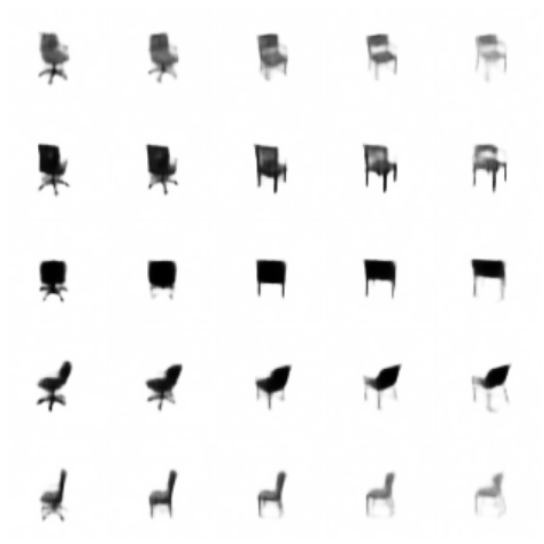

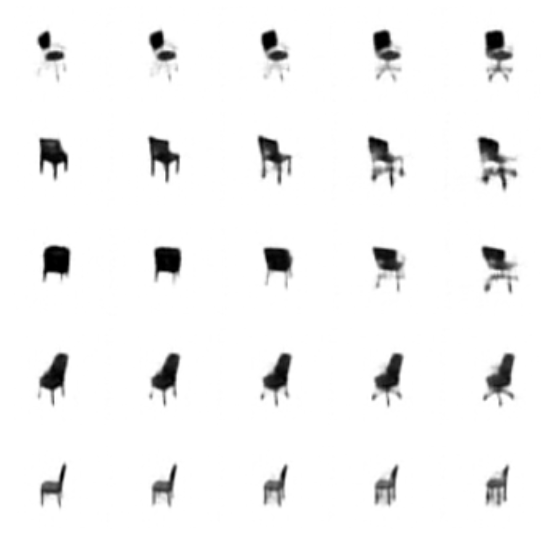

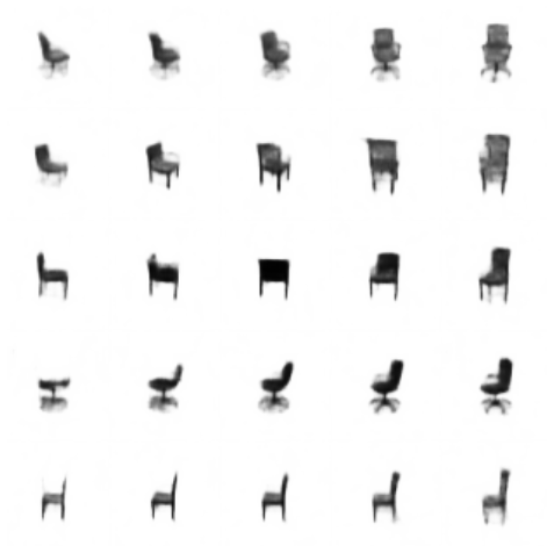

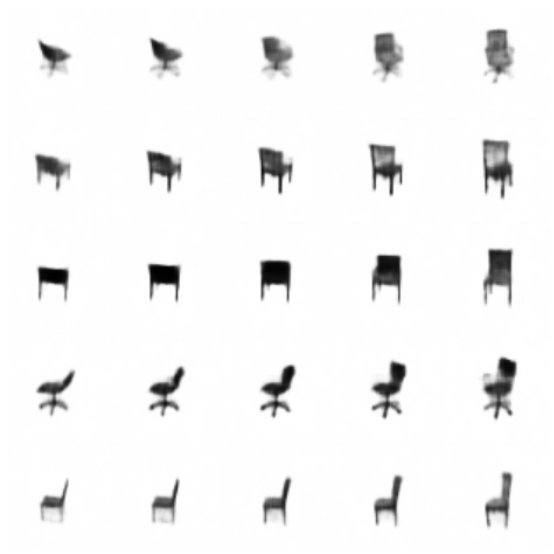

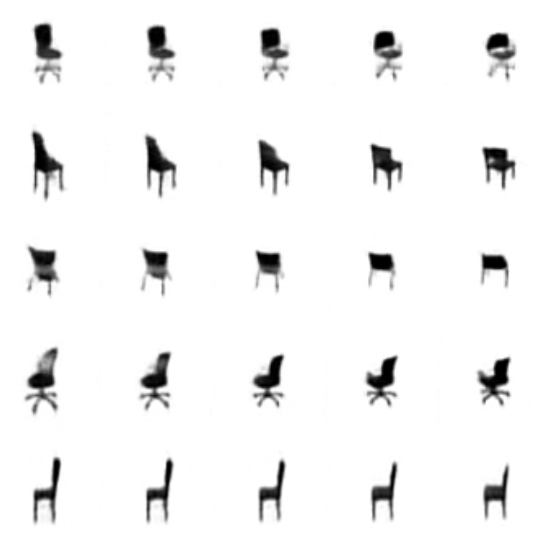

以3D chairs数据集为例展示我们方法的解纠缠效果。如图1所示,图中包含了我们的方法与当前最优秀的两种以VAE为基础的解纠缠算法的对比,图中可看出β-VAE能够学习到的解纠缠表示个数最少,且全部被噪声纠缠;第二种方法能够发现和β-CapsNet同样多的因素,但是解纠缠效果不好,且图像更模糊。

β-VAE |

β-TCVAE |

β-CapsNet |

|

|

|

Azimuth |

||

|

|

|

Chair size |

||

|

|

|

Leg style |

||

|

|

|

Backrest |

||

Factor not learnt |

|

|

Swivel |

||

图1 解纠缠效果展示

论文小结:

我们介绍β-CapsNet,一个用信息瓶颈理论学习解纠缠胶囊表示的新方法,用变分推断构造信息瓶颈约束的下界,然后近似替换成胶囊的均值约束,新的约束方式更简单且在胶囊网络中的效果更好。在监督学习中,提出了类别独立掩码向量帮助模型学习更好的解纠缠表示并提高可解释性;在无监督模型中,我们提出了胶囊网络的无监督结构,对应的无监督动态路由算法。大量的实验证明,无论是有标签样本还是无标签样本,新的算法都能使胶囊网络的表示学习到更好的解纠缠效果。

刘建伟,副教授

博士生导师/硕士生导师。长期从事模式识别与智能系统、复杂系统分析与智能控制、机器学习和数据挖掘方面的研究工作。美国数学会《数学评论》评论员,中国人工智能学会机器学习分会高级会员。在计算机学报,自动化学报、计算机研究与发展、Neurocomputing、TNNLS等期刊上和国内国际会议上发表学术研究论文200多篇,其中三大检索150多篇。联系方式:liujw@cup.edu.cn